This post was originally published on this site.

Un avión de la Fuerza Aérea Real Británica que transportaba al secretario de Defensa del Reino Unido, John Healey, sobrevolaba la semana pasada Estonia, cerca de la frontera con Rusia, cuando ocurrió algo extraño.

Según los datos de vuelo examinados por el servicio global de la BBC, el transpondedor del avión comenzó de repente a indicar que se encontraba en pleno territorio ruso, a 300 kilómetros de donde había estado segundos antes.

Supuestamente volaba a solo 11 kilómetros por hora sobre un lago cerca de San Petersburgo.

Nada de esto era real. El sistema de navegación del avión se confundió debido a una suplantación de GPS.

Esto ocurre cuando una zona se inunda de señales de radio que imitan las de los satélites GPS.

Dado que las señales de los satélites son relativamente débiles cuando llegan a la Tierra, un transmisor terrestre puede emitir señales falsas más potentes, a las que los sistemas de navegación, incluidos los de los aviones, pueden sintonizarse.

La suplantación suele ser ejecutada principalmente por ejércitos que buscan reducir la precisión de las armas enemigas que utilizan navegación GPS, como misiles de largo alcance y pequeños drones.

Muchos ejércitos cuentan con unidades especializadas que construyen transmisores en bases fijas o que los desplazan en vehículos.

Pero los vuelos comerciales se están viendo atrapados en esta guerra electrónica.

Los pilotos de la Real Fuerza Aérea (RAF, por sus siglas en inglés) se vieron obligados a guiar el avión utilizando un sistema de navegación más antiguo y menos preciso que funciona en paralelo al GPS.

El Ministerio de Defensa afirmó que la seguridad del avión no se vio comprometida.

De hecho, no fue la única aeronave en la zona que se vio afectada ese día.

Los datos compartidos con la BBC por la consultora de aviación SkAI Data Services muestran que más de 100 aviones de pasajeros transmitían ubicaciones incorrectas como consecuencia de la suplantación.

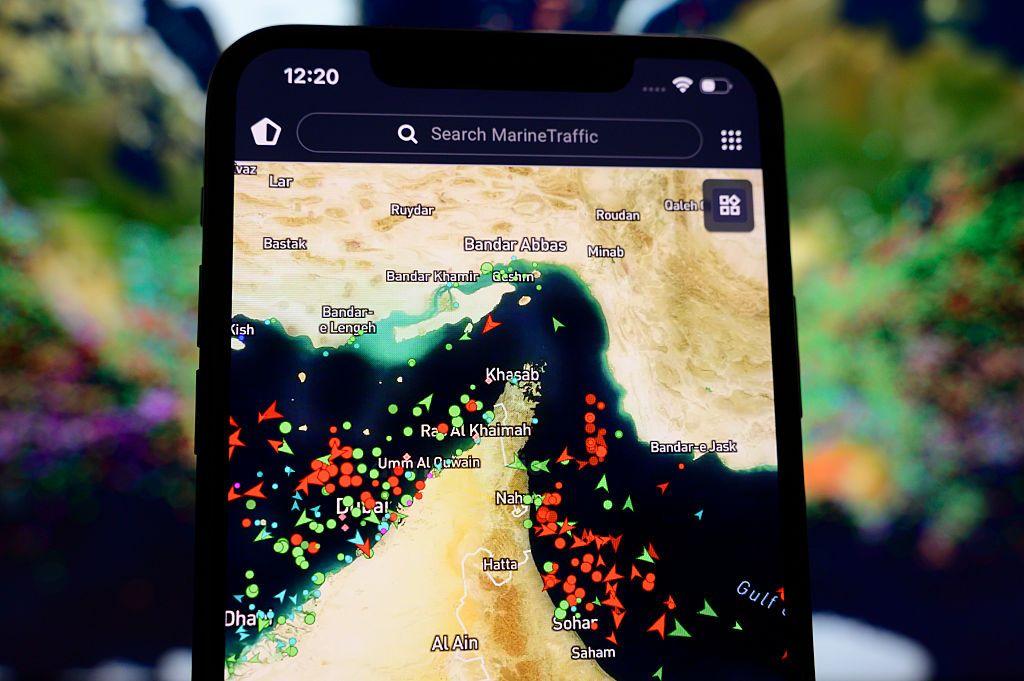

Los mismos datos indican que la suplantación y el bloqueo —otro tipo de interferencia que ahoga las señales de los satélites para impedir que el GPS funcione— están cada vez más extendidos en áreas cercanas a zonas de guerra o donde hay mucha actividad militar, como la región del Báltico, el Golfo, el Mar Rojo, India y Pakistán, y los alrededores de Myanmar.

En el Golfo, por ejemplo, se produjo un aumento de los vuelos que notificaron suplantación de GPS tras el inicio de la guerra de Estados Unidos e Israel contra Irán el 28 de febrero.

En marzo, 5.381 vuelos notificaron suplantación, frente a los 99 de febrero y los 14 de enero, según SkAI Data Services.

Los casos en la región del Báltico se dispararon de 17.243 en 2024 a 59.447 en 2025, según muestran las cifras de SkAI Data Services.

Este incremento coincide con el uso creciente de ataques con drones en la guerra entre Rusia y Ucrania.

Otras rutas aéreas muy transitadas de Europa, Medio Oriente y Asia también han sufrido suplantaciones o interferencias, con una media de más de 800 vuelos afectados al día en todo el mundo este año.

Dado que la tecnología necesaria está fácilmente al alcance de la mayoría de los países, a los expertos les preocupa que este fenómeno se generalice.

Un piloto experimentado

Es un problema al que se enfrentó el piloto británico Sam Rutherford cuando voló en una avioneta de cuatro plazas de Arabia Saudita a Omán el mes pasado.

Cuando estaba cerca de la frontera entre Arabia Saudita y los Emiratos Árabes Unidos, los sistemas de navegación y el piloto automático de la aeronave dejaron de funcionar.

Al principio pensó que podría tratarse de un problema del avión, pero varias aerolíneas de la zona estaban reportando el mismo problema.

Resultó que tanto la suplantación como el bloqueo del GPS estaban afectando a su aeronave.

Rutherford, quien pilotó helicópteros en el ejército británico durante ocho años, utilizó la brújula magnética de su avión y se puso en contacto con el controlador de tráfico aéreo para que le ayudara a guiarse hasta su destino.

Aunque aterrizó sin incidentes, afirma: “Si me hubiera encontrado con mal tiempo, con poco combustible y de noche, la situación habría sido muy diferente”.

Los riesgos de la suplantación

Uno de los peligros de la suplantación es que, si se engaña a una aeronave para que crea que se encuentra en una ubicación diferente, los pilotos podrían verse obligados a desactivar o ignorar las alertas de sus sistemas de advertencia de colisión con el suelo, afirma Tanja Harter, presidenta de la Asociación Europea de Cabinas de Pilotos, que representa a unos 40.000 pilotos.

Este sistema avisa a los pilotos cuando considera que están a punto de chocar contra el suelo o contra obstáculos como montañas.

Harter afirma que hay muchos informes de pilotos que reciben falsas alertas de “ascenso”, incluso cuando vuelan a 37.000 pies de altura.

Los radares que ayudan a los aviones a evitar el mal tiempo también pueden dejar de funcionar, añade.

Aunque muchas aerolíneas hacen un buen trabajo en el momento de dar información a los pilotos, Harter añade que la combinación de estos problemas “está degradando la red de seguridad a bordo del avión”.

Al describir su experiencia con la suplantación, el piloto Artur Rodionov afirma que un “salto de Lituania al Mar del Norte” fue la mayor diferencia entre la realidad y la ubicación mostrada en pantalla que había visto.

“Son más de 1.000 millas” (1.600 kilómetros), dice Rodionov, quien pilota pequeños aviones de pasajeros para la compañía chárter de Estonia Diamond Sky Aviation.

En respuesta a estos sucesos “habituales”, Rodionov afirma que su empresa desarrolló protocolos para hacer frente a la suplantación, entre los que se incluye que los pilotos desconecten el sistema GPS cuando vuelen en zonas conocidas por las interferencias.

De este modo, el piloto puede supervisar si las señales de la aeronave están siendo falsificadas, para evitar que el resto de equipos de navegación del avión se vean afectados.

Rodionov afirma que la suplantación de señales podría, en particular, causar complicaciones a pilotos sin experiencia o cuando los aviones se enfrentan a otros problemas, como una avería mecánica o un fallo del equipo.

“Sin duda, supone una carga de trabajo adicional”, dice.

Interferencias permitidas

No es ilegal que los países interfieran con el GPS.

El organismo de las Naciones Unidas que regula las señales de radiodifusión, la Unión Internacional de Telecomunicaciones, lo permite con fines de seguridad o defensivos, aunque ha expresado su “profunda preocupación” por el hecho de que su uso generalizado esté amenazando la seguridad de las aeronaves.

El organismo europeo de seguridad de la navegación aérea, Eurocontrol, afirma que los aviones cuentan con “medidas de mitigación para garantizar que se mantenga la seguridad” durante la suplantación y que la tecnología de navegación de la aeronave y el control del tráfico aéreo en tierra pueden guiar al avión.

Los fabricantes de aeronaves colaboran estrechamente con los proveedores de aviación para encontrar soluciones técnicas a la suplantación, añade.

Pero, en privado, hay indicios de que las organizaciones de aviación, incluida Eurocontrol, están más preocupadas.

En una presentación del organismo de seguridad identificada como “no destinada al público en general”, pero a la que tuvo acceso la BBC, se advierte que la suplantación “socava fundamentalmente los principios actuales de seguridad en la cabina”.

Los expertos del sector sugieren que hay más urgencia por encontrar una solución al problema de lo que se admite públicamente.

“Las aerolíneas claman por mejoras”, afirma Todd Humphreys, profesor de ingeniería aeroespacial en la Universidad de Texas.

“La aviación trabaja con tecnología GPS que tiene más de 20 años”. Humphreys señala que la industria necesita “receptores GPS resistentes a la suplantación y a las interferencias”.

“Creo que lo que tendremos que hacer es desarrollar nuevas tecnologías que sean mucho más resistentes”.

Soluciones posibles

Entre las posibles soluciones se incluyen la actualización del software de los aviones para filtrar las interferencias, el uso de antenas direccionales para que los equipos ignoren las señales falsas procedentes del suelo y sistemas de navegación totalmente nuevos que funcionen junto con el GPS.

Pero introducir cambios en equipos críticos para la seguridad puede llevar tiempo.

Humphreys advierte que no solo el transporte comercial puede verse afectado por la suplantación y el bloqueo del GPS. Incluso puede afectar a las aplicaciones de mapas de los teléfonos.

“Se trata del tráfico marítimo, de la gente que conduce por las carreteras”, afirma.

“Cada vez que estalle un conflicto en el futuro, cabe esperar que el GPS sea una de las primeras víctimas”.

Haz clic aquí para leer más historias de BBC News Mundo.

Suscríbete aquí a nuestro nuevo newsletter para recibir cada viernes una selección de nuestro mejor contenido de la semana.

También puedes seguirnos en YouTube, Instagram, TikTok, X, Facebook y en nuestro nuevo canal de WhatsApp.

Y recuerda que puedes recibir notificaciones en nuestra app. Descarga la última versión y actívalas.

- “Nervios de acero”: Tammie Jo Shults, la piloto de combate que salvó la vida de 148 pasajeros

- Por qué el combustible para aviones es especialmente vulnerable a la guerra en Irán (y cómo puede afectar a nuestras vacaciones)

- El repentino fin de Spirit, la “revolucionaria” aerolínea que popularizó el modelo de bajo costo en EE.UU.

![[]](https://cablesdenoticias.prensalibre.com/wp-content/uploads/2026/05/800983c0-4d47-11f1-ac78-2112837ce2aa.png)