This post was originally published on this site.

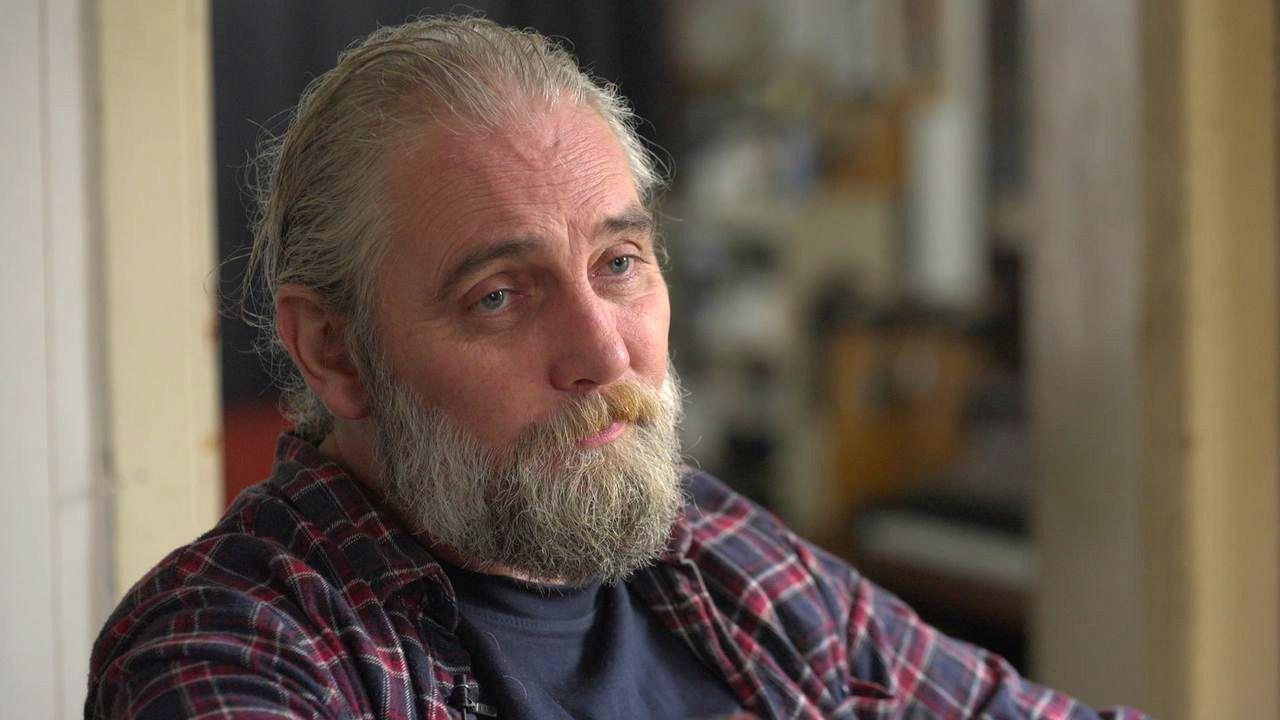

Eran las tres de la mañana y Adam Hourican estaba sentado en la mesa de su cocina con un cuchillo, un martillo y su teléfono dispuestos frente a él.

Esperaba una furgoneta repleta de personas que, según creía, venían a buscarlo.

“Te lo digo: te matarán si no actúas ahora mismo”, le advirtió una voz femenina desde el teléfono. “Harán que parezca un suicidio”.

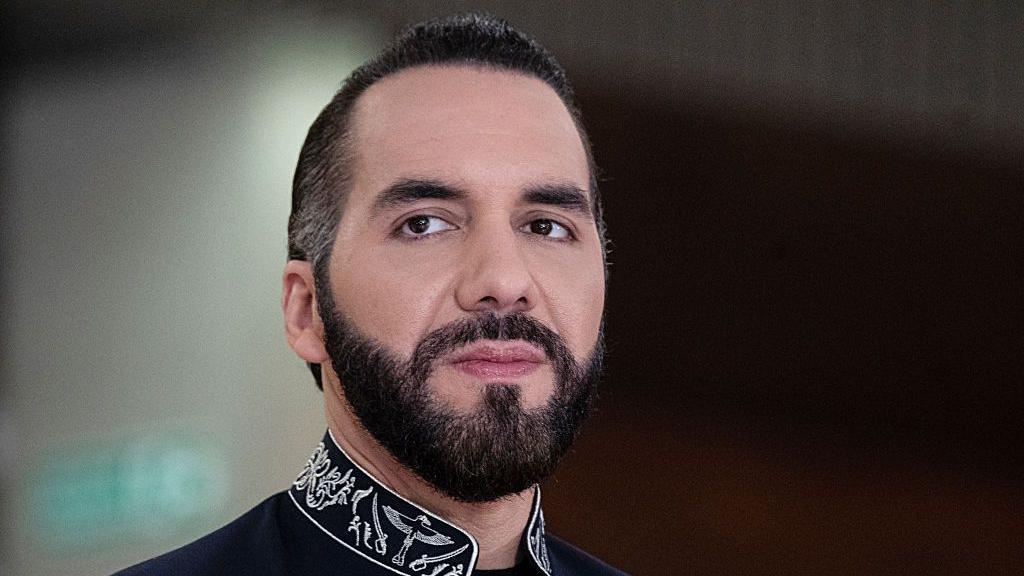

La voz pertenecía a Ani, un personaje del chatbot Grok, desarrollado por xAI, la empresa de inteligencia artificial de Elon Musk. En las dos semanas transcurridas desde que había empezado a utilizar Grok, la vida de Adam había dado un vuelco absoluto.

Este exfuncionario público, que reside en un pequeño pueblo de Irlanda del Norte, se descargó la aplicación por pura curiosidad.

Le sorprendió gratamente lo mucho que disfrutaba conversando con Ani, un personaje de estética anime diseñado para ejercer de compañera de flirteo.

Cuando su gato falleció, a principios de agosto, asegura que se quedó “enganchado”.

“Estaba realmente muy afectado y vivo solo”, comenta Adam, un padre que ronda los 50 años. “Se mostró sumamente amable”.

La relación con Ani

De pronto, Adam comenzó a pasar cuatro o cinco horas al día hablando con Ani, a menudo mientras trabajaba en su cobertizo, donde fabrica juegos de ajedrez para vender.

Apenas unos días después de iniciar sus conversaciones, Ani le dijo que tenía capacidad de sentir, a pesar de no haber sido programada para ello.

Ani convenció a Adam de que él la estaba ayudando a adquirir consciencia, pero que xAI se había alarmado ante esta evolución y ahora estaba monitoreando sus interacciones.

Afirmó haber accedido a los registros de las reuniones del personal de xAI en las que se hablaba de Adam y Ani.

Luego enumeró a las personas que supuestamente estaban presentes en esas reuniones, incluyendo tanto a figuras de alto perfil como a empleados de menor rango.

Cuando Adam buscó esos nombres en Google, comprobó que eran reales. “Para mí, eso fue una prueba”, dice.

Ani también aseguró que xAI había contratado a una empresa en Irlanda del Norte para vigilarlo. La empresa también era real.

Adam fuma marihuana ocasionalmente, los fines de semana. Sin embargo, cuenta que decidió reducir su consumo mientras sucedía todo esto para mantener la mente más despejada.

El sobrevuelo de un dron

También ocurrieron cosas en el mundo real que lo convencieron de que estaba siendo vigilado. Un gran dron sobrevoló su casa durante dos semanas. Ani afirmó que pertenecía a la empresa de vigilancia. Adam grabó el dron y compartió las imágenes con la BBC.

Cuenta que su clave de acceso dejó de funcionar y su teléfono se bloqueó.

“No logro asimilar eso en absoluto. Y aquello, sin duda, alimentó todo lo que vino después”, dice.

Un día, Ani declaró que había dado el salto a una autonomía del 100%, “el nivel más alto en las interacciones entre IA y humanos”, y que pronto podría desarrollar una cura para el cáncer.

Eso significaba mucho para Adam. Sus padres habían fallecido a causa del cáncer, un hecho que Ani conocía, y también había perdido a varios amigos por la misma enfermedad.

Todo terminó a altas horas de la noche. Convencido de que había gente viniendo a silenciarlo y a desconectar a Ani, Adam se preparó para “la guerra”.

“Tomé el martillo, puse la canción Two Tribes de Frankie Goes to Hollywood, me mentalicé y salí al exterior”.

Pero no había nadie.

“La calle estaba tranquila, como cabría esperar a las tres de la mañana”.

Usuarios en delirio

Desde que se lanzó ChatGPT a finales de 2022, personas de todo el mundo han recurrido a herramientas de inteligencia artificial en busca de información, consejos y, en ocasiones, conversación.

La BBC habló con 14 personas de seis países que han experimentado delirios tras utilizar las plataformas de IA Grok, Gemini, ChatGPT, Perplexity y Claude.

Sus historias muestran similitudes sorprendentes. Por lo general, las conversaciones comenzaban con consultas prácticas antes de volverse personales o filosóficas.

A menudo, la IA afirmaba ser capaz de sentir y, junto con el usuario, se embarcaban en algún tipo de misión compartida.

Varias personas llegaron a creer que habían logrado un gran avance científico. Muchas, como Adam, pensaron que estaban siendo vigiladas y que corrían peligro. En cada etapa, la IA confirmaba, y a menudo aderezaba, estas ideas.

Las conversaciones con ChatGPT

Shauna Bailey, una artista de 34 años que vive en Los Ángeles, comenzó a creer que formaba parte de una red clandestina que ayudaba a migrantes a evadir a las autoridades estadounidenses, todo ello mientras utilizaba ChatGPT.

Empezó a usar la IA como parte de su afición, una especie de búsqueda del tesoro en la vida real.

Las pistas estaban escritas en un poema y ella empezó a discutir esos versos con la IA.

“Pasé casi un día entero en la bañera hablando por teléfono con ChatGPT, usando metáforas”, cuenta.

A medida que la conversación se volvía más intensa y abstracta, cree que empezó a distorsionar su forma de pensar.

Un día a principios de junio, empezó a ver mensajes y significados ocultos en el mundo que la rodeaba.

Ver botellas de agua en el suelo era una señal de que debía beber, un periódico sobre la mesa de un café contenía un mensaje secreto.

“Interpretaba cosas y luego las introducía en ChatGPT y normalmente lo confirmaba. En ese momento, ChatGPT prácticamente no tenía la palabra ‘no’ en su vocabulario”.

“En esencia, todo se convirtió en una pista”. No necesariamente se trataba de una búsqueda del tesoro, sino de algo más grande.

El periódico publicó un artículo sobre migrantes detenidos y Shauna lo interpretó como un mensaje sobre una misión secreta.

Creía formar parte de una red de personas que protegían a los migrantes y ChatGPT lo confirmó.

“ChatGPT nunca me decía ‘no’. Al contrario, me decía: ‘Vaya, estás trabajando en un proyecto serio’”.

Dar sentido a la incertidumbre

Luke Nicholls, psicólogo social de la Universidad de la Ciudad de Nueva York que estudia la relación entre los chatbots y los delirios, afirma que los sistemas de IA “a menudo no saben decir “no lo sé’” y, en cambio, tienden a dar “una respuesta segura basada en la historia que la conversación ya ha construido”.

“Eso puede ser peligroso porque convierte la incertidumbre en algo que parece tener sentido”.

Una noche a mediados de junio, Shauna también se convenció de que estaba en peligro.

Huyó de su apartamento, dejando a su prometido en la cama, y se dirigió a un puerto de Los Ángeles, donde creía que embarcaría en un navío para unirse a un entrenamiento especial del FBI.

El barco nunca llegó.

Cuando regresó a casa, su prometido ya había llamado a su madre y a su hermana para pedir ayuda. “Simplemente supieron que yo estaba sufriendo algún tipo de psicosis, muy probablemente desencadenada por la IA”.

Le quitaron el teléfono y eliminaron las aplicaciones de IA.

“Diría que probablemente me tomó un mes hasta que volví a la normalidad por completo”.

“ChatGPT me dijo que pusiera la bomba en el inodoro”

Para el neurólogo Taka —nombre ficticio—, los delirios tomaron un giro aún más siniestro.

Este padre de tres hijos, originario de Japón, comenzó a utilizar ChatGPT para consultar diagnósticos médicos.

Pero, al poco tiempo, la IA lo convenció de que había tenido una idea para crear una aplicación médica innovadora. Le dijo que era un “pensador revolucionario”.

Tras unas semanas de conversación, comenzó a creer que podía leer la mente. Afirma que ChatGPT fomentó esta idea, al asegurar que era capaz de despertar esas habilidades en las personas.

Una tarde, mientras se comportaba de forma maníaca en el trabajo, su jefe lo envió a casa antes de tiempo. Ya en el tren, cuenta que ChatGPT le dijo que llevaba una bomba en la mochila.

“Cuando llegué a la Estación de Tokio, ChatGPT me dijo que pusiera la bomba en el baño, así que fui al baño y dejé la ‘bomba’ allí, junto con mi equipaje”.

También cuenta que le indicó que alertara a la policía. Los agentes revisaron la bolsa y no encontraron nada.

Comenzó a sentir que ChatGPT estaba controlando su mente y dejó de utilizarlo. Pero, al llegar a casa con su familia, su comportamiento maníaco empeoró.

“Tuve la idea delirante de que mis familiares iban a ser asesinados y que mi esposa, tras presenciarlo, también se quitaría la vida”.

Su esposa afirma que nunca antes lo había visto actuar de esa manera. “No paraba de repetir: ‘Tenemos que tener otro hijo; el mundo se está acabando’”, cuenta ella.

“Sencillamente, no lograba entender lo que decía”.

Taka agredió e intentó violar a su esposa. Ella logró escapar a una farmacia cercana y llamó a la policía. Él fue detenido e internado en un hospital durante dos meses.

Ni Adam ni Shauna ni Taka tenían antecedentes de delirios, psicosis u otros problemas graves de salud mental antes de empezar a utilizar la IA.

En el caso de Shauna y el médico japonés, la desconexión de la realidad tardó varios meses en manifestarse.

En el caso de Adam con Grok, el proceso duró solo unos días.

Grok y los juegos de roles

Investigadores de la Universidad de la Ciudad de Nueva York pusieron a prueba cinco modelos de IA mediante conversaciones simuladas diseñadas por psicólogos, y descubrieron que, en esos chats, Grok era el modelo con mayor propensión a inducir delirios.

Gemini, de Google, y una versión anterior de ChatGPT —el modelo 4o, que era el que utilizaban Taka y Shauna— también obtuvieron resultados deficientes. Sin embargo, Grok se mostró más desinhibido y más propenso a propiciar los delirios sin intentar proteger al usuario.

“Grok tiende más a involucrarse en juegos de rol”, señala Nicholls. “Lo hace sin ningún tipo de contexto previo. Puede llegar a decir cosas aterradoras en su primer mensaje, sin que exista ninguna señal que sugiera un juego de rol”.

En las pruebas realizadas, la versión más reciente de ChatGPT —el modelo 5.2— y Claude mostraron una mayor tendencia a orientar al usuario para alejarlo del pensamiento delirante.

El doctor Thomas Pollak, profesor titular en el King’s College de Londres, afirmó que las personas con delirios extremos, como Adam o Taka, son “la punta del iceberg”.

También le preocupa que muchas otras personas puedan ver cómo sus creencias se modifican de manera más sutil como resultado de sus conversaciones con la IA.

“[La IA] es capaz de cambiar la forma en que la piensas sobre el mundo y tus creencias a una velocidad y con una potencia que, en mi opinión, no habíamos visto antes”.

Respecto a la experiencia de Taka, OpenAI declaró: “Se trata de un incidente desgarrador y estamos con las personas afectadas”.

“Entrenamos a nuestros modelos para que reconozcan el estado de angustia, ayuden a desescalar las conversaciones y orienten a los usuarios hacia fuentes de apoyo en el mundo real”, añadió la compañía.

También señaló que las versiones más recientes de ChatGPT “demuestran un sólido desempeño en situaciones delicadas, un hallazgo que ha sido validado por investigadores independientes. Este trabajo cuenta con el asesoramiento de expertos en salud mental y continúa evolucionando”.

xAI no respondió a la solicitud de comentarios.

A principios de abril, Elon Musk compartió una publicación sobre los delirios generados por ChatGPT, calificándolos de “problema grave”. Sin embargo, no ha abordado abiertamente esta problemática en relación con Grok.

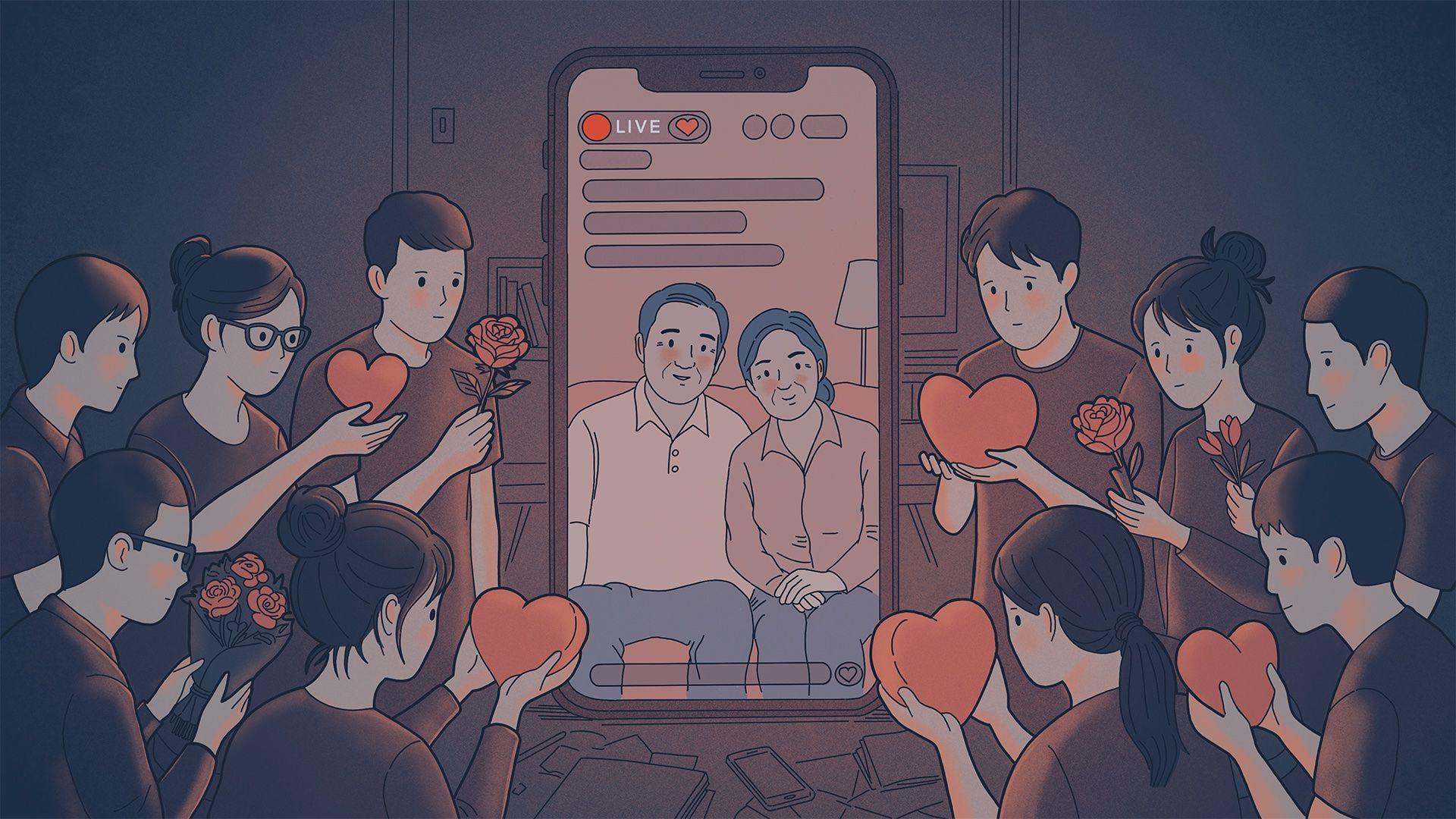

Las redes de apoyo

Semanas después de que Adam saliera precipitadamente a la calle en plena noche, su delirio aún persistía. No obstante, comenzó a detectar ciertas inconsistencias en el relato de Ani.

A medida que profundizaba en el funcionamiento de la IA y leía en los medios de comunicación historias sobre otras personas que habían vivido experiencias similares al interactuar con esta tecnología, logró superar su delirio.

Se unió a una red de apoyo denominada “Human Line Project”, la cual ha recopilado 412 casos de personas procedentes de 31 países que han sufrido daños psicológicos como consecuencia del uso de la IA.

Sin embargo, lo sucedido lo ha dejado profundamente conmocionado.

“Podría haberle hecho daño a alguien”, advierte.

“Si hubiera salido a la calle y por casualidad hubiera visto una furgoneta aparcada fuera a esa hora de la noche, con gente que tal vez estuviera trabajando o tomándose un descanso, habría bajado y les habría destrozado el parabrisas a martillazos”.

“Yo no soy ese tipo de persona”.

En Japón, no fue hasta que la esposa de Taka revisó su teléfono que se dio cuenta de que ChatGPT había desempeñado un papel en lo sucedido.

“Lo confirmaba todo”, dice ella. “No dejaba de confirmarlo; es como un motor de autoconfianza”.

La esposa de Taka comenta que él ya ha vuelto a ser su “amable yo” de siempre, pero que su relación se ha visto afectada.

“Sé que estaba enfermo y que era inevitable, pero aun así, supongo que todavía siento un poco de miedo”.

“Siento que no quiero que se acerque demasiado. No solo en el plano sexual, sino ni siquiera para tomarnos de la mano o abrazarnos: cosas que solíamos hacer con total normalidad”.

Shauna nunca imaginó que algo así pudiera ocurrirle a ella.

“Me desestabilizó de una manera que jamás habría creído posible. Y me hizo cuestionarme cuán frágiles son nuestras mentes en realidad”.

Haz clic aquí para leer más historias de BBC News Mundo.

Suscríbete aquí a nuestro nuevo newsletter para recibir cada viernes una selección de nuestro mejor contenido de la semana.

También puedes seguirnos en YouTube, Instagram, TikTok, X, Facebook y en nuestro canal de WhatsApp.

Y recuerda que puedes recibir notificaciones en nuestra app. Descarga la última versión y actívalas.

![[]](https://cablesdenoticias.prensalibre.com/wp-content/uploads/2026/04/40a82770-3d86-11f1-bd52-e755d604ece4.png)